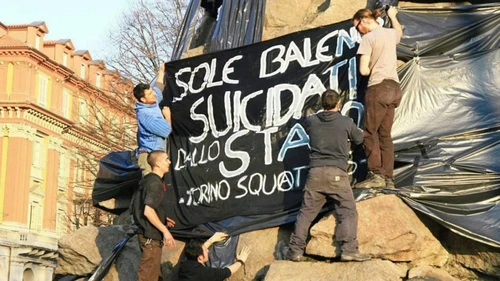

L’Anarchico ‘Baleno’ ucciso dal terrorismo psicologico dello stato stragista

ricercatori senza padroni - Friday, March 27, 2026Sabato 28 marzo c’è il 28° anniversario dell’uccisione di Edoardo Massari, conosciuto come “Baleno”, trovato impiccato nel carcere delle Vallette di Torino. Lui e la sua compagna d’amore e di lotta Maria Soledad Rosas “Sole” (foto sotto), sono stati accusati ingiustamente di aver compiuto azioni ecoterroristiche nel torinese, subirono una terribile gogna mediatica (terrorismo psicologico) …

Leggi tutto "L’Anarchico ‘Baleno’ ucciso dal terrorismo psicologico dello stato stragista"